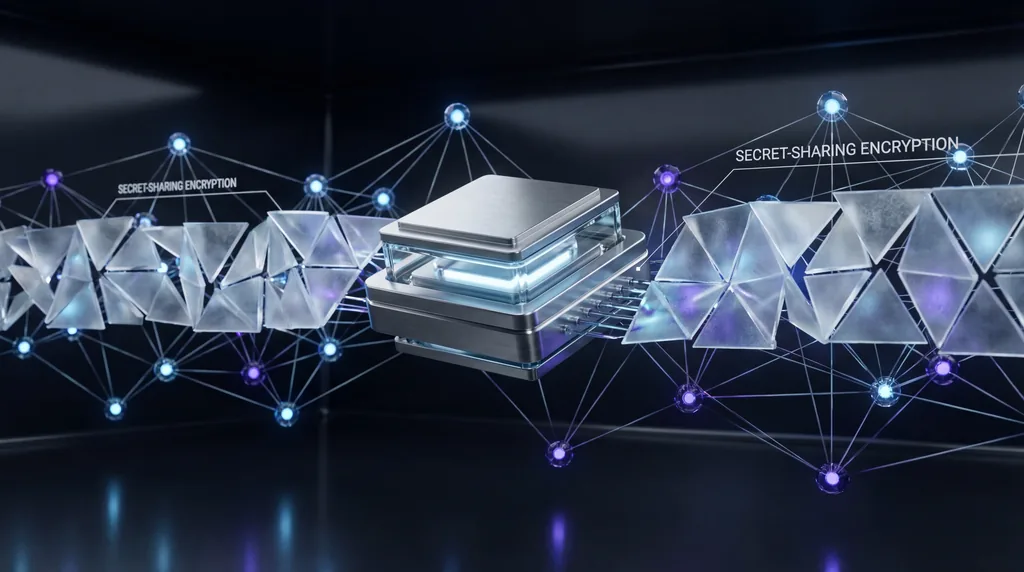

El monitoreo que preserva la privacidad es computacionalmente costoso porque las técnicas criptográficas tradicionales, como los garbled circuits y la evaluación de funciones privadas, introducen sobrecargas masivas al procesar cientos de miles de compuertas por cada observación. La investigación dirigida por Thomas A. Henzinger aborda esto reemplazando el cifrado pesado y monolítico con una arquitectura distribuida de secret-sharing que permite un rendimiento en tiempo real sin comprometer la sensibilidad de los datos.

La verificación en tiempo de ejecución (runtime verification) sirve como una salvaguarda crítica en la informática moderna, proporcionando una comprobación continua de si la ejecución de un sistema cumple con sus especificaciones formales. Tradicionalmente, este proceso depende de un monitor monolítico: una única entidad que observa todos los eventos del sistema. Aunque es eficaz para la seguridad, este modelo centralizado crea un riesgo significativo para la privacidad, ya que el monitor a menudo requiere acceso a flujos de datos sensibles. Proteger estos datos mediante métodos de cifrado estándar históricamente ha resultado demasiado lento para entornos en vivo, creando un "impuesto a la privacidad" que muchos desarrolladores no pueden permitirse pagar.

¿Por qué el monitoreo que preserva la privacidad es computacionalmente costoso?

El monitoreo que preserva la privacidad es computacionalmente costoso debido a la sobrecarga introducida por técnicas criptográficas como la computación multi-parte (MPC) y los garbled circuits, que requieren el procesamiento de circuitos de tamaños enormes. Estos métodos implican costes computacionales significativos que conducen a desafíos de escalabilidad, con ralentizaciones del rendimiento que pueden alcanzar de 100 a 100.000 veces en comparación con la computación no privada.

Thomas A. Henzinger y sus colegas, K. S. Thejaswini y Mahyar Karimi, destacan que el principal cuello de botella proviene de la complejidad de las "compuertas" dentro de estos circuitos criptográficos. En una configuración tradicional que preserva la privacidad, cada observación que realiza el sistema debe traducirse en una serie de operaciones matemáticas que ocultan la entrada. Para sistemas con grandes espacios de estados, el número de compuertas requeridas puede superar las 10^5, lo que hace casi imposible mantener los requisitos de baja latencia de los sistemas distribuidos o de la infraestructura ciberfísica en tiempo real.

Los métodos existentes que preservan la privacidad a menudo tienen dificultades con los requisitos de latencia porque intentan aplicar primitivas pesadas a cada evento individual en un flujo de datos. Esto da como resultado un sistema donde el tiempo necesario para verificar un solo paso excede el tiempo que tarda en ocurrir el siguiente paso, lo que genera una acumulación de datos no verificados. Para solucionar esto, los investigadores proponen alejarse del modelo de cifrado monolítico hacia un marco distribuido más ágil que aproveche el poder de los esquemas de secret-sharing.

¿Cuáles son las ventajas de distribuir monitores entre múltiples partes?

Distribuir los monitores entre múltiples partes permite la computación colaborativa sobre entradas privadas sin revelarlas, preservando la privacidad tanto de los datos del sistema como de las especificaciones. Este enfoque mejora la escalabilidad porque el tiempo de ejecución del protocolo depende más del tamaño de la especificación que del tamaño total del sistema, lo que permite la verificación de sistemas propietarios o implementados sin requerir acceso al código fuente.

La innovación central en el trabajo de Thomas A. Henzinger involucra el protocolo "Sharing The Secret", que divide la tarea de monitoreo entre varias entidades diferentes. Al asegurar que al menos una de estas partes sea "honesta" —lo que significa que no colude con otras para robar datos—, el sistema puede usar un secret-sharing eficiente en lugar de un cifrado intensivo. Esta suposición de mayoría honesta es una piedra angular de la nueva arquitectura, lo que permite que el sistema mantenga sólidas garantías de privacidad mientras reduce significativamente la sobrecarga asociada con la computación multi-parte tradicional.

Al utilizar esquemas de secret-sharing, el proceso de monitoreo se vuelve mucho más ágil. En lugar de que un único monitor posea las claves de todos los datos, la información se fragmenta en piezas que son inútiles por sí solas. Los monitores distribuidos realizan cálculos locales sobre estos fragmentos y solo combinan los resultados para llegar a un veredicto (por ejemplo, "el sistema es seguro" o "se produjo una infracción"). Esta comunicación minimizada —a menudo un solo mensaje por observación— mejora drásticamente la eficiencia de los protocolos de privacidad de datos en entornos de alta velocidad.

Superando el desafío de la persistencia de estado

La persistencia del estado interno es un obstáculo importante en el monitoreo que preserva la privacidad porque la mayoría de los protocolos de secret-sharing están diseñados para ejecuciones de "un solo uso" que no transfieren información de un paso al siguiente. En la verificación en tiempo de ejecución, el monitor debe recordar eventos pasados para determinar el estado actual del sistema. Esta investigación introduce un protocolo diseñado específicamente para el monitoreo continuo, que permite evaluaciones repetidas sobre un estado interno en evolución que permanece oculto tanto para el sistema como para las entidades de monitoreo.

Los investigadores desarrollaron un método para mantener este estado interno en secreto a través de un mecanismo recursivo de secret-sharing. A medida que el sistema evoluciona, los monitores distribuidos mantienen sus "participaciones" (shares) locales del estado sin ver nunca el panorama completo. Esto garantiza que incluso si una parte de monitoreo se ve comprometida, no pueda reconstruir la historia del comportamiento del sistema ni predecir sus estados futuros. Este avance hace que el secret-sharing pase de ser una herramienta estática a un motor dinámico capaz de manejar procesos complejos y de larga duración.

Mantener la confidencialidad del estado de monitoreo es particularmente vital para los sistemas propietarios. A menudo, la lógica del monitor en sí misma —la "especificación"— es un secreto comercial. Si el estado interno se filtrara, un competidor podría potencialmente aplicar ingeniería inversa a la lógica operativa del sistema. Al mantener el estado en evolución y oculto, el protocolo de Henzinger proporciona una doble capa de protección: una para los datos del usuario que se monitorean y otra para la propiedad intelectual del propio servicio de monitoreo.

¿Puede el monitoreo distribuido funcionar en aplicaciones en tiempo real?

El monitoreo distribuido puede funcionar en aplicaciones en tiempo real intercambiando solo un mensaje por paso de observación, lo que admite una verificación ligera sin bloquear la ejecución del sistema. Las evaluaciones experimentales utilizando el framework MP-SPDZ confirman que este protocolo puede manejar tamaños de circuito moderados con una seguridad aceptable, lo que lo hace viable para el monitoreo en línea en escenarios como los sistemas ciberfísicos.

Para probar la viabilidad en el mundo real de su protocolo, el equipo implementó el sistema utilizando el framework MP-SPDZ, una herramienta de evaluación versátil para la computación multi-parte. Sus resultados demostraron que el enfoque distribuido es significativamente más escalable que cualquier alternativa monolítica existente. Si bien todavía existe una brecha de rendimiento en comparación con el monitoreo no privado, la sobrecarga se reduce a un nivel en el que el almacenamiento en búfer de eventos puede ocultar la latencia, permitiendo veredictos oportunos incluso en contextos críticos para la seguridad.

Las implicaciones de esta investigación son de gran alcance, particularmente para los diagnósticos de sistemas que cumplen con la privacidad. A medida que las regulaciones como el RGPD y la CCPA se vuelven más estrictas, las empresas necesitan formas de verificar el estado de sus sistemas sin exponer información sensible de los usuarios a las herramientas de diagnóstico. La capacidad de monitorear un sistema de manera distribuida significa que los dispositivos de atención médica, las redes financieras y los sistemas domésticos inteligentes pueden ser verificados en cuanto a seguridad y corrección, manteniendo los datos del usuario estrictamente confidenciales.

Preguntas frecuentes

¿Por qué el monitoreo que preserva la privacidad es computacionalmente costoso?

- Alta complejidad de circuitos: Requiere el procesamiento de cientos de miles de compuertas para ocultar datos.

- Sobrecarga criptográfica: Los métodos estándar como los garbled circuits introducen ralentizaciones de 100 a 100.000 veces.

- Grandes espacios de estados: Los sistemas en tiempo real generan cantidades masivas de datos que son difíciles de cifrar instantáneamente.

¿Cuáles son las ventajas de distribuir monitores entre múltiples partes?

- Escalabilidad mejorada: El rendimiento está vinculado al tamaño de la especificación en lugar del tamaño del sistema.

- Comunicación minimizada: Los protocolos a menudo requieren solo un intercambio de mensajes por paso.

- Protección de propiedad: Permite la verificación de sistemas sin revelar el código fuente subyacente.

¿Puede el monitoreo distribuido funcionar en aplicaciones en tiempo real?

- Intercambios de un solo mensaje: El protocolo garantiza que el monitoreo no bloquee la ejecución.

- Capacidades de almacenamiento en búfer: Los retrasos cortos se pueden gestionar almacenando eventos en búfer para obtener veredictos casi en tiempo real.

- Validación experimental: Las pruebas con el framework MP-SPDZ muestran que es significativamente más rápido que los métodos criptográficos tradicionales.

El futuro de la verificación en tiempo de ejecución reside en estos modelos distribuidos. Al romper el monolito, investigadores como Thomas A. Henzinger están allanando el camino para un mundo donde la seguridad del sistema y la privacidad del usuario ya no sean mutuamente excluyentes. Las direcciones futuras para este trabajo incluyen optimizar aún más los esquemas de secret-sharing para tamaños de circuito incluso mayores y explorar el uso de aceleración por hardware para ampliar aún más los límites de la preservación de la privacidad en tiempo real.

Comments

No comments yet. Be the first!