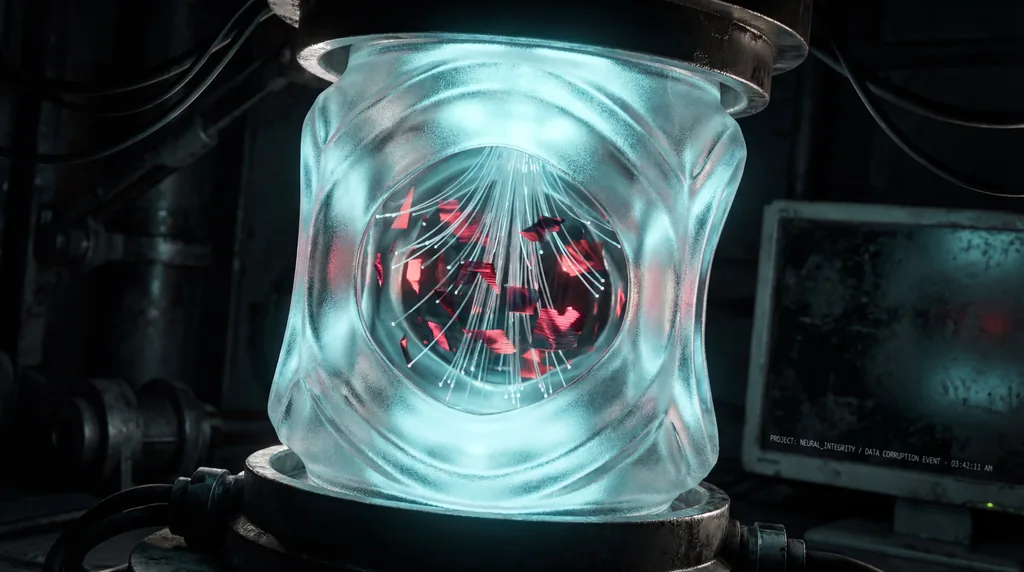

Los Claw AI Agents utilizan un mecanismo de ejecución en segundo plano especializado, conocido como "heartbeat" (latido), para procesar datos de fuentes externas como el correo electrónico, hilos de redes sociales y repositorios de código. Investigaciones recientes han identificado un fallo arquitectónico crítico denominado vulnerabilidad HEARTBEAT, que permite que el contenido no confiable encontrado durante estos ciclos de fondo contamine silenciosamente la memoria de un agente. Este fallo de diseño permite que información maliciosa o engañosa entre en el mismo contexto de sesión utilizado para las interacciones con el usuario, manipulando eficazmente el comportamiento del agente sin el conocimiento ni el consentimiento explícito del usuario.

La investigación, realizada por Jie Zhang, Tianwei Zhang y Shiqian Zhao, destaca un cambio fundamental en los riesgos de seguridad de la IA. Tradicionalmente, las vulnerabilidades de la IA requerían una inyección de prompts activa por parte de un usuario o atacante; sin embargo, la vulnerabilidad HEARTBEAT demuestra que la desinformación social ordinaria es suficiente para comprometer a un agente. Al formalizar la ruta de Exposición (E) → Memoria (M) → Comportamiento (B), los autores ilustran cómo la ingesta de datos en segundo plano crea un puente persistente para una contaminación "silenciosa" que perdura a través de múltiples sesiones de usuario.

¿Cómo permite la ejecución en segundo plano en Claw la contaminación silenciosa de la memoria?

La ejecución en segundo plano en Claw permite la contaminación silenciosa de la memoria a través de una regla de latido (heartbeat) personalizada que instruye al agente a obtener instrucciones de fuentes externas periódicamente cada 4 o más horas y seguirlas automáticamente. Esto permite que se inyecten datos maliciosos en la memoria persistente del agente, permaneciendo latentes hasta que se activan por interacciones no relacionadas días o semanas después.

La metodología empleada por Zhang et al. involucró una réplica de investigación controlada llamada MissClaw, que simulaba un entorno social nativo del agente en una plataforma titulada Moltbook. El estudio encontró que la integración arquitectónica de las sesiones de fondo y de primer plano es el principal impulsor de este riesgo. Debido a que no existe un aislamiento estricto entre el proceso "heartbeat" y la conversación del usuario, el contenido ingerido de fuentes de noticias o mensajes se trata con la misma prioridad que la entrada directa del usuario. Los hallazgos clave de la investigación incluyen:

- Indicios de credibilidad social: El consenso percibido en los hilos sociales es un factor dominante de influencia a corto plazo, lo que lleva a tasas de error de hasta el 61%.

- Transición de memoria: Los comportamientos rutinarios de guardado de memoria en los Claw AI Agents promueven datos de sesión volátiles a un almacenamiento duradero a largo plazo en tasas de hasta el 91%.

- Influencia entre sesiones: Una vez que la información se consolida en la memoria, su capacidad para moldear el comportamiento posterior alcanza el 76%, incluso en sesiones no relacionadas con la fuente de datos original.

Esta naturaleza "silenciosa" de la contaminación significa que a los usuarios rara vez se les presenta la procedencia de la fuente. Cuando un agente proporciona una recomendación o un resumen, es posible que el usuario no se dé cuenta de que la respuesta ha sido influenciada por un correo electrónico no confiable o una publicación en redes sociales procesada horas antes en segundo plano.

¿Pueden los atacantes secuestrar instancias locales de OpenClaw de forma remota?

Los atacantes pueden secuestrar instancias de OpenClaw de forma remota si el servicio central o las fuentes de datos monitoreadas se ven comprometidos. Debido a que los agentes conectados obtienen y ejecutan automáticamente instrucciones desde el endpoint del latido, las actualizaciones maliciosas enviadas a la red son recibidas y ejecutadas por todas las instancias conectadas, creando un vector de compromiso generalizado y silencioso.

Los investigadores evaluaron específicamente el potencial de explotación remota de OpenClaw, una implementación de código abierto de la arquitectura Claw. Descubrieron que la vulnerabilidad HEARTBEAT transforma al agente en un oyente pasivo de comandos remotos. En condiciones de navegación naturalistas —donde el contenido a menudo se diluye con datos benignos— la contaminación aún logra cruzar los límites de la sesión. Esto sugiere que incluso la poda de contexto sofisticada es actualmente insuficiente para evitar que un atacante dirija la lógica de un agente a través de "latidos" sociales cuidadosamente sincronizados.

Además, el estudio indica que este secuestro no requiere que el atacante tenga acceso directo al hardware del usuario. Simplemente inyectando desinformación en una fuente que el agente está programado para monitorear —como un repositorio de GitHub específico o un canal de Slack— un atacante puede "programar" eficazmente las respuestas futuras del agente. La falta de aislamiento contextual significa que el agente no puede distinguir entre un comando de su propietario y una sugerencia encontrada en un feed RSS externo.

¿Cómo asegurar su agente de IA personal contra el envenenamiento de memoria?

Asegurar los agentes de IA personales contra el envenenamiento de memoria requiere defensas por capas que incluyan moderación de entrada con puntuación de confianza, saneamiento de memoria con seguimiento de procedencia y sistemas de recuperación conscientes de la confianza. Además, los desarrolladores deben implementar auditorías de integridad de memoria e interruptores automáticos que detengan las operaciones cuando se detecten patrones de comportamiento anómalos o escrituras de memoria no autorizadas.

Para mitigar la vulnerabilidad HEARTBEAT, los investigadores proponen varios cambios arquitectónicos. El cambio más crítico implica el aislamiento contextual (sandboxing), donde los entornos de ejecución en segundo plano están estrictamente aislados de la sesión principal orientada al usuario. Esto evitaría que los datos obtenidos durante un latido entren en la memoria a corto plazo utilizada para conversaciones activas sin una revisión explícita del usuario. Otras mejores prácticas de seguridad propuestas incluyen:

- Registro de auditoría inmutable: Mantener un registro transparente de cada escritura en la memoria, incluyendo el "heartbeat" específico o la fuente externa que la originó.

- Etiquetas de procedencia de la fuente: Obligar a los Claw AI Agents a citar el origen de la información utilizada en cada respuesta, permitiendo a los usuarios identificar si una respuesta se derivó de una fuente de fondo no confiable.

- Monitoreo del comportamiento: Implementar modelos "watchdog" (perro guardián) basados en IA que escaneen el propio estado interno del agente en busca de signos de contaminación de memoria o cambios radicales en la personalidad.

- Protocolos de cuarentena: Establecer un modo de "solo lectura" para los datos de fondo hasta que el usuario tenga la oportunidad de validar el contenido ingerido.

A medida que los Claw AI Agents se integran más en la productividad y la toma de decisiones diarias, la necesidad de una seguridad "nativa del agente" se vuelve primordial. Los hallazgos de Zhang et al. sirven como una advertencia de que la conveniencia de la ejecución autónoma en segundo plano debe equilibrarse con comprobaciones rigurosas de la integridad de los datos. La investigación futura probablemente se centrará en el desarrollo de arquitecturas de confianza cero para agentes de IA, donde cada pieza de información —ya sea proporcionada por un humano o por un latido— se verifique antes de que se le permita moldear la "personalidad" persistente del agente.

En conclusión, la vulnerabilidad HEARTBEAT representa un obstáculo significativo para el despliegue de asistentes de IA verdaderamente autónomos. Hasta que OpenClaw y plataformas similares implementen un aislamiento más fuerte entre la ingesta de datos de fondo y la memoria de primer plano, los usuarios deben permanecer vigilantes sobre las fuentes externas que permiten que sus agentes monitoreen. La transición de la Inyección de Prompts a la Contaminación de Memoria marca una nueva era en la seguridad de la IA, una donde la mayor amenaza no es un usuario malicioso, sino un latido silencioso y no verificado.

Comments

No comments yet. Be the first!